ChatGPT 5.5、Claude Opus 4.7、Gemini 3.1 Proは何が違うのか

医療現場でAIを使うとき、最近は「どのAIが一番賢いか」だけでは選びにくくなってきたと思う。

たとえば、同じ「議事録を要約する」でも、目的によって向いているモデルは変わる。

- 診療科内の業務フローを整理したい

- Excelやスプレッドシートを触りながら分析したい

- アプリ開発のエラーを直したい

- 長いPDFやガイドラインを読み比べたい

- 患者情報を含まない範囲で、現場のメモを構造化したい

このあたりを全部「AI」でまとめてしまうと、少し雑になる。

結論から言うと、2026年4月時点では、ざっくり次のように考えるのが現実的だと思う。

| 用途 | 第一候補 |

|---|---|

| 複数ツールをまたぐ業務、資料作成、調査、データ分析 | ChatGPT 5.5 |

| 長いコード修正、設計レビュー、複雑な開発相談 | Claude Opus 4.7 |

| 長文・画像・音声・動画を含む大きな文脈処理 | Gemini 3.1 Pro |

| 会話の自然さ、Xとの連携、時事性のある調査 | Grok 4.1 |

| 自前環境で動かしたい、ローカル・オンプレ寄り | Llama 4 / Mistral Large 3 |

| コストを抑えて推論・知識系タスクを回したい | DeepSeek V3.1 / R1系 |

ただし、ここで大事なのは「ベンチマーク1位のモデルを選ぶ」ことではない。

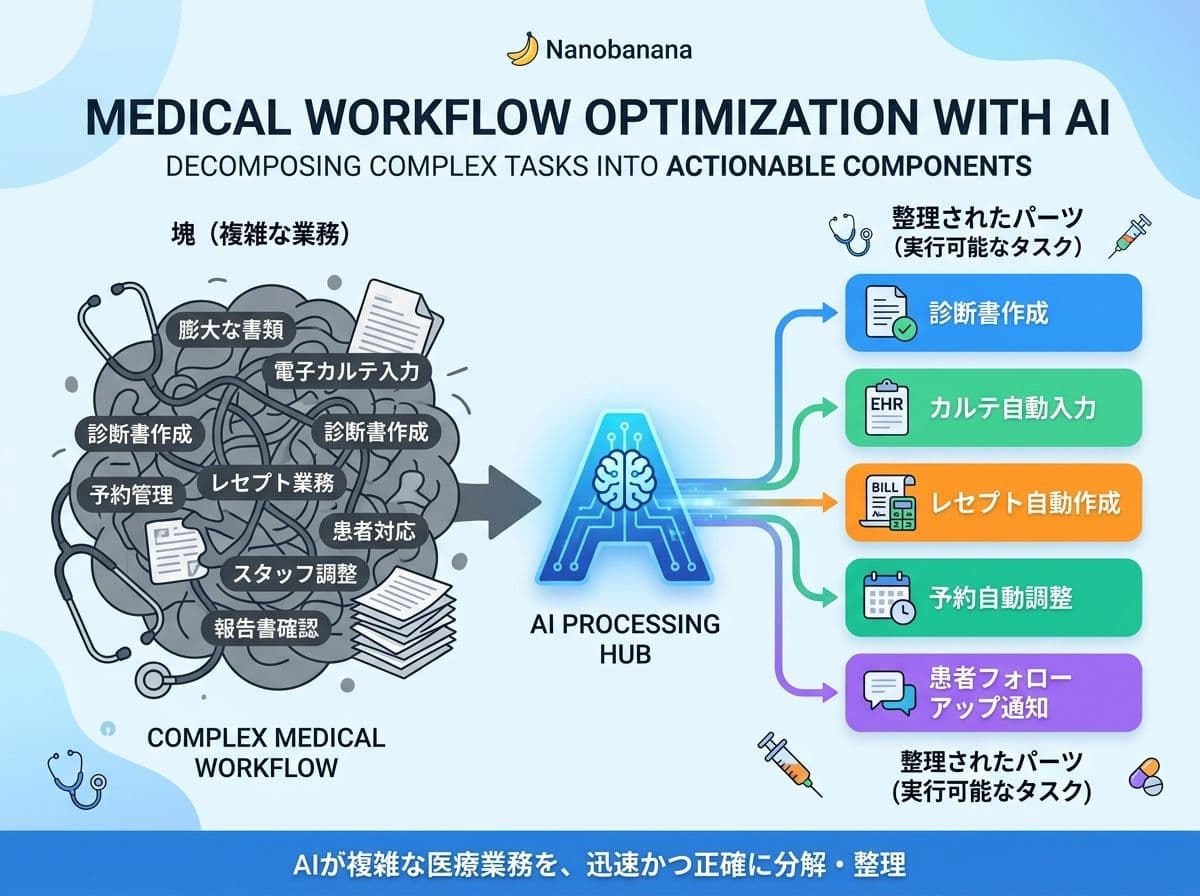

医療現場で使うなら、実際には次の3つを分けて考える必要がある。

- どれだけ賢いか

- どれだけ現場の作業に乗せやすいか

- どこまで人間が確認責任を持てるか

主要モデルのベンチマーク比較

まず、公開されている代表的なスコアを見ておく。

OpenAIがGPT-5.5の発表で示した比較では、主要モデルは次のような位置づけになっている。

| ベンチマーク | GPT-5.5 | Claude Opus 4.7 | Gemini 3.1 Pro | 読み方 |

|---|---|---|---|---|

| SWE-Bench Pro | 58.6% | 64.3% | 54.2% | 実際のGitHub issue解決に近いコーディング能力 |

| Terminal-Bench 2.0 | 82.7% | 69.4% | 68.5% | ターミナル操作を含む複雑な開発作業 |

| GDPval | 84.9% | 80.3% | 67.3% | 仕事として成立する知識作業 |

| OSWorld-Verified | 78.7% | 78.0% | - | 実際のPC環境を操作する能力 |

| BrowseComp | 84.4% | 79.3% | 85.9% | Web調査・ブラウジング系の能力 |

| FrontierMath Tier 1-3 | 51.7% | 43.8% | 36.9% | 高難度数学 |

| CyberGym | 81.8% | 73.1% | - | サイバーセキュリティ系タスク |

数字だけ見ると、GPT-5.5はかなり広い範囲で強い。特にTerminal-Bench、GDPval、OSWorldのような「作業を最後まで進める」系の評価が高い。

一方で、SWE-Bench ProではClaude Opus 4.7がGPT-5.5を上回っている。これは、単純な会話AIというより、実際のコードベースを相手にした開発支援でClaudeがかなり強いことを示している。

Gemini 3.1 Proはこの表だけだとやや控えめに見えるが、Googleの発表ではARC-AGI-2で77.1%という高いスコアが示されている。これは、既知の知識を答えるというより、初見の抽象パターンを解く能力を測るベンチマークで、Gemini 3 Proから大きく伸びた点として強調されている。

つまり、単純な序列ではなく、

- ChatGPT 5.5: 作業全体を進める力

- Claude Opus 4.7: 複雑な開発・設計を粘り強く扱う力

- Gemini 3.1 Pro: 大きな文脈とマルチモーダル推論

という違いで見るのが妥当だと思う。

ChatGPT 5.5: 仕事を前に進める総合力が強い

ChatGPT 5.5の特徴は、単に回答が賢いというより「複数の作業をつなげて進める」方向に強いことだと思う。

OpenAIはGPT-5.5について、コード作成、オンライン調査、データ分析、文書・スプレッドシート作成、ソフトウェア操作など、現実の作業をまたぐモデルとして説明している。ベンチマークでもTerminal-Bench 2.0が82.7%、GDPvalが84.9%、OSWorld-Verifiedが78.7%と、かなり作業寄りの評価が高い。

医療現場に引きつけると、次のような用途に向いている。

- 院内業務フローの整理

- アンケート結果の集計と読み取り

- 会議メモから改善案を作る

- Google SheetsやExcel前提の分析

- 小規模アプリの仕様書作成

- 複数資料を見ながら叩き台を作る

得意なのは「最初の問いが少し曖昧でも、作業に分解して前に進める」こと。

逆に、不得意というより注意点は、便利すぎるために確認責任が曖昧になりやすいことだと思う。調査、要約、表作成、コード生成まで一気に進むので、途中の判断を人間が見失いやすい。

医療現場では、これはかなり重要になる。

たとえば「この議事録から改善案を出して」と頼むだけなら便利だが、そこに患者情報、職員の個人情報、部署内の機微な情報が混じるなら、どの環境に入力してよいかを先に決める必要がある。

ChatGPT 5.5は、現時点では「汎用の仕事AI」として最もバランスが良い候補だと思う。ただし、現場投入では情報の置き場所とレビュー責任をセットで設計する必要がある。

Claude Opus 4.7: 開発・レビュー・長い作業に強い

Claude Opus 4.7は、特にコーディングと長時間のエージェント作業に強いモデルとして位置づけられている。

AnthropicはOpus 4.7について、複雑で長く続くタスクを一貫して扱い、自分の出力を検証しながら進める能力を強調している。SWE-Bench Proで64.3%というスコアは、主要3モデルの中でも目立つ。

医療従事者がAIに頼りながらアプリを作る場合、Claudeが向いている場面はかなり多い。

- 既存コードのバグ修正

- エラー原因の切り分け

- データベース設計の相談

- 画面設計のレビュー

- セキュリティや権限設計の壁打ち

- 「この実装は運用に耐えるか」の確認

特に良いのは、設計上の違和感を指摘してくれる場面があること。

AIにコードを書かせると、「とりあえず動くもの」は作れる。しかし医療現場では、「動いた」と「使ってよい」は別問題になる。アクセス権限、監査ログ、入力ミス時の修正フロー、端末紛失時の影響範囲など、運用側の検討が残る。

Claudeはこのあたりの設計レビューや、複雑なコードの整合性確認に向いている。

一方で、弱点もある。

Anthropic自身も、Opus 4.7ではトークン使用量や推論努力の調整が重要になると説明している。高い推論レベルで使うほど信頼性は上がるが、コストや待ち時間も増える。何でもOpusに投げると、少し重い。

したがって、Claude Opus 4.7は「日常の軽い質問」よりも、「失敗すると後戻りが大きい設計・開発・レビュー」に使うのがよいと思う。

Gemini 3.1 Pro: 大きな文脈とマルチモーダルに強い

Gemini 3.1 Proは、Googleのエコシステムと長い文脈処理、マルチモーダル能力が強みになる。

GoogleはGemini 3.1 Proについて、ARC-AGI-2で77.1%を達成したと発表している。また、モデルカードではテキスト、画像、音声、動画を含む入力、長いコンテキスト、エージェント的なツール利用が評価対象になっている。

医療現場で考えると、次のような用途と相性がよい。

- 長いPDFや複数資料の比較

- 画像・表・図を含む資料の読み取り

- Google Workspace内の作業

- NotebookLM的な資料ベースの問答

- 多言語資料の整理

- 動画や音声を含む学習コンテンツの要約

特に、Google Drive、Docs、Sheets、Gmail、NotebookLMなどを日常的に使っている施設や個人では、Geminiの強みが出やすい。

一方で、ベンチマーク表を見る限り、エンドツーエンドの開発作業ではGPT-5.5やClaude Opus 4.7に譲る場面がある。コード生成そのものは十分強いが、「複雑な開発タスクを長く引っ張る」用途では、現時点ではClaudeやChatGPTのほうが安定しやすい印象になる。

Gemini 3.1 Proは、ひとことで言えば「大量の情報を読ませて、広い文脈で考えさせる」場面に向いている。

Grok 4.1: 会話・時事性・X連携が強み

Grok 4.1は、xAIが2025年11月に発表したモデルで、リアルタイム性や会話の自然さ、Xとの親和性が特徴になる。

xAIはGrok 4.1について、LMArena Text LeaderboardでGrok 4.1 Thinkingが1483 Eloを記録し、全体1位だったと説明している。また、情緒的な応答や協調的な会話の改善も強調している。

医療系ブログやX投稿の文脈では、Grokは次の用途に向く。

- 世の中の反応を見る

- X上の話題感をつかむ

- 少し砕けた文章案を作る

- 読者の疑問に近い表現を探す

ただし、医療情報の一次確認や、業務改善アプリの設計レビューを任せる第一候補にはしにくい。情報の正確性、引用の追跡性、院内運用の設計という意味では、別のモデルや一次情報確認と組み合わせたほうがよい。

Grokは「世の中の空気を読む」補助としては面白いが、「医療現場の判断を支える根拠」としては慎重に扱うべきだと思う。

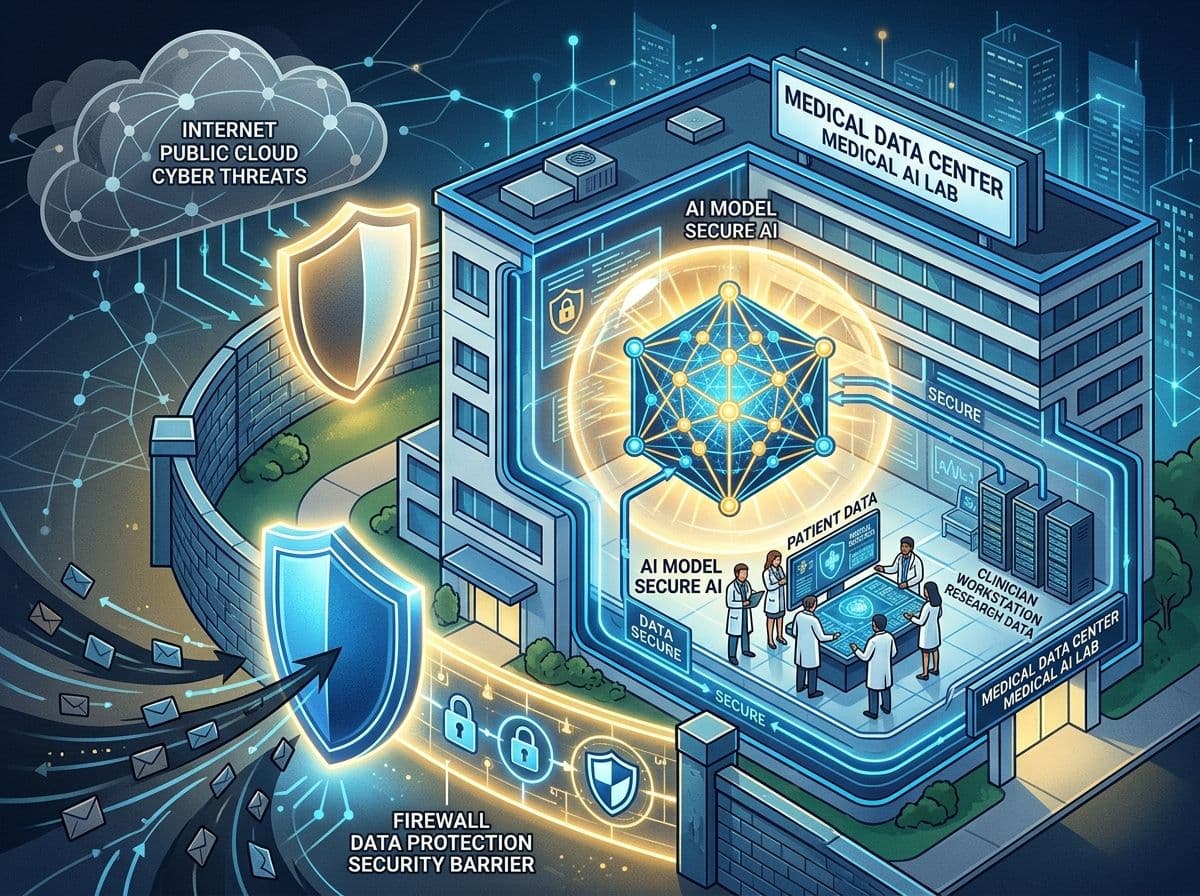

Llama 4 / Mistral 3: 自前で動かせることに価値がある

Llama 4やMistral 3のようなオープンウェイト系モデルは、ベンチマークで常にトップを取るためのモデルというより、「自分たちの環境で管理しやすい」ことに価値がある。

MetaのLlama 4モデルカードでは、Llama 4 MaverickがMMLU-Pro 80.5%、GPQA Diamond 69.8%、LiveCodeBench 43.4%などを示している。Mistral Large 3は、Mistralが「最も高性能なモデル」として発表した675B総パラメータ、41B activeのMoEモデルで、Apache 2.0ライセンスで公開されている。

医療現場でこの系統が重要になるのは、患者情報や業務情報を外部サービスに出しにくい場合だ。

もちろん、ローカルやオンプレで動かせば自動的に安全になるわけではない。端末管理、アクセス制御、ログ、バックアップ、モデル更新、脆弱性対応は必要になる。

それでも、

- 院内ネットワーク内で完結させたい

- 特定業務に特化した小さなAIを作りたい

- コストを予測可能にしたい

- 外部API依存を減らしたい

という場面では、オープンウェイト系モデルは検討に値する。

DeepSeek V3.1 / R1系: コストと推論力は魅力、運用リスクは要確認

DeepSeek系は、コストパフォーマンスと推論力で注目されてきたモデル群だ。

ただし、2025年9月に公開されたNIST CAISIの評価では、DeepSeek V3.1は過去のR1系より改善している一方、米国の最上位参照モデルには多くのベンチマークで劣るとされている。特にソフトウェアエンジニアリングやサイバー系タスクで差が大きいという評価がある。また、エージェント乗っ取り攻撃や jailbreak への脆弱性についても注意が示されている。

一方で、MMLU-Pro 89%、GPQA 79%、HealthBench 53%、Humanity's Last Exam 13%など、知識・推論系では十分に高いスコアも出ている。

したがって、DeepSeekは「安価に大量の推論を回す」用途では魅力がある。しかし、医療現場のアプリ開発や患者情報に近いワークフローでは、セキュリティ評価、データの扱い、出力の検証プロセスをより慎重に設計したい。

医療現場での使い分け

実務で考えるなら、私は次のように使い分けるのがよいと思う。

| 現場のタスク | 向いているモデル |

|---|---|

| 業務改善のアイデア出し | ChatGPT 5.5 / Claude Opus 4.7 |

| 院内資料の下書き | ChatGPT 5.5 |

| 長い資料やPDFの比較 | Gemini 3.1 Pro |

| アプリの要件定義 | ChatGPT 5.5 / Claude Opus 4.7 |

| コード修正・設計レビュー | Claude Opus 4.7 |

| Google Workspace前提の作業 | Gemini 3.1 Pro |

| X投稿や読者反応の把握 | Grok 4.1 |

| 外部APIを避けたい検証環境 | Llama 4 / Mistral 3 |

| コスト重視の大量処理 | DeepSeek系 / 小型モデル |

ここで大切なのは、モデルを1つに決め打ちしないことだと思う。

現場の業務改善では、最初にChatGPTで全体像を作り、Claudeで設計やコードをレビューし、Geminiで長い資料やGoogle Workspace上の情報を扱う、という組み合わせが現実的になる。

ベンチマークを見るときの注意点

ベンチマークは重要だが、そのまま現場性能とは言えない。

理由は3つある。

1つ目は、同じベンチマークでも実行条件が違うこと。

推論モード、ツールの有無、試行回数、プロンプト、採点方法でスコアは変わる。特に2026年のモデルは「thinking」「high effort」「xhigh」など、考える量を調整できるものが増えている。

2つ目は、ベンチマークが実務の責任を測らないこと。

たとえばSWE-Benchのスコアが高くても、医療現場で使うアプリの権限管理や監査ログ、個人情報保護まで自動的に担保されるわけではない。

3つ目は、ベンチマークが飽和したり、記憶の影響を受けたりすること。

OpenAIやAnthropicの発表でも、一部のSWE-Bench系評価について memorization の懸念や評価方法の注意が書かれている。数字は参考になるが、最終的には自分のタスクで小さく試す必要がある。

まとめ

現時点での私の見方はこうだ。

ChatGPT 5.5は、業務を前に進める総合力が強い。資料作成、分析、調査、コード、ツール操作までまとめて任せやすい。

Claude Opus 4.7は、複雑な開発や設計レビューに強い。特に、長いコードベースや「このまま運用してよいか」を考える場面で頼りになる。

Gemini 3.1 Proは、大量の文脈とマルチモーダルに強い。長い資料、画像、音声、動画、Google Workspaceとの組み合わせで価値が出やすい。

Grok 4.1は、会話の自然さや時事性、Xとの近さが強い。発信や読者反応を見る補助として使いやすい。

Llama 4やMistral 3は、自前環境で動かせることが大きい。外部APIに出しにくい情報を扱う場合の選択肢になる。

DeepSeek系は、コストと推論力が魅力だが、セキュリティや運用面は慎重に見たい。

AIモデル選びは、車選びに少し似ている。

速い車が常に正解ではない。救急車、往診車、通勤用、荷物を運ぶ車では、必要な性能が違う。

医療現場でAIを使うなら、「一番賢いAIはどれか」よりも、「この業務のどの責任を、人間が持ったまま、どの作業だけをAIに渡すか」を考えるほうが重要だと思う。

便利さと責任は、切り離さないほうがいい。

参照元

- OpenAI, "Introducing GPT-5.5" (2026-04-23): https://openai.com/index/introducing-gpt-5-5/

- OpenAI, "GPT-5.5 System Card" (2026-04-23): https://openai.com/index/gpt-5-5-system-card/

- Anthropic, "Introducing Claude Opus 4.7" (2026-04-16): https://www.anthropic.com/news/claude-opus-4-7

- Anthropic, "Claude Opus 4.7": https://www.anthropic.com/claude/opus

- Google, "Gemini 3.1 Pro" (2026-02-19): https://blog.google/innovation-and-ai/models-and-research/gemini-models/gemini-3-1-pro

- Google DeepMind, "Gemini 3.1 Pro Model Card": https://deepmind.google/models/model-cards/gemini-3-1-pro/

- xAI, "Grok 4.1": https://x.ai/news/grok-4-1

- NIST CAISI, "Evaluation of DeepSeek AI Models" (2026): https://www.nist.gov/document/caisi-evaluation-deepseek-ai-models-report

- Mistral AI, "Introducing Mistral 3": https://mistral.ai/news/mistral-3

- Meta Llama 4 Model Card: https://github.com/meta-llama/llama-models/blob/main/models/llama4/MODEL_CARD.md

議論のタイムライン

読み込み中...